大概在四年前了解到计算神经学这一学科. 当时感觉这应该是自己最终的归宿, 先后在coursera上跟过神经元与脑、 计算神经科学两门课程, 但是都没有完成.

17后期到18年, 由于个人感情的问题, 整个人的成长接近停滞. 今年好容易状态恢复. 又拾起这本dayan & abbott经典的<Theoretical Neuroscience>, 准备系统的入个门.

概述

意识问题是现代科学的基本问题之一, 不同的学科对之有不同层次的理解, 并分别试图从各自的角度来解决这一问题.

生物物理学从的意识的物理材料入手, 研究神经元、 神经回路的物理性质、电化学性质, 以此来理解意识问题. 神经科学试图从神经元, 大脑皮层的层面来探索不同脑组织的功能, 通过整合不同大脑模块, 形成意识的初步图景, 这两者都是从还原论的视角来逼近意识问题.

而心理和认知科学则从功能应用的角度出发, 探索意识的作用, 汇总在面临不同情况时, 意识的反应模式及其功能表现, 试图通过描述意识的外在表现来了解意识.

同时还有人工智能学科, 通过数学与统计学, 在类比建模的基础, 使用电子芯片来完成类似于意识的同样功能, 从而反推意识问题的计算本质.

然而, 前两者过于微观, 事实上, 从细胞到组织, 从组织到大脑之间, 这些不同层次间有着巨大的鸿沟, 整体并不等于个体的简单加和, 这也就是网络科学所谈的”涌现”, 因此, 单纯地研究单个细胞的功能对理解整体固然有益, 但是不从全局的视角来理解每一部分所起的作用的话, 很难将纷繁的生物组织性质纳入统一的框架. 从而总结出具有启发性的观点.

心理与认知科学则过于聚焦在对不同功能的列举性描述, 缺乏对于不同认知功能的系统性归纳. 对于研究意识来说, 目的性不强. 而人工智能的曲线救国路径, 虽然能够建造精妙的智能机器, 却仍然需要更多的工作来去芜存精, 对所推出与的结论与神经科学的生物事实放在一起, 进行关联比较分析, 厘定到底哪些是意识计算所必须和共通的部分, 而又有哪些是受限于特定的计算架构和算法的, 独特的部分(如gpu分布式计算, 或反向传播算法).

计算神经科学, 就是这其中缺失的一环.

计算神经科学, 致力于汇总不同层次的已知实验现象和解剖学事实, 归纳比较不同生物组织的功能和作用, 通过数学和信息论的视角来将这些知识综合在一起, 解释从生物神经元、 神经回路到心理行为的计算过程. 对于智能提出一个统一的框架.

简单来说, 就是分析神经系统能做什么, 它们是通过什么结构, 利用哪些性质来做到的. 为什么它们要通过这样的方式, 组织成这样的形态来完成这一目的.

三种模型

计算神经学科中的模型的可以分为描述性模型, 机制性模型和解释性模型三种.

描述性模型(descriptive models)

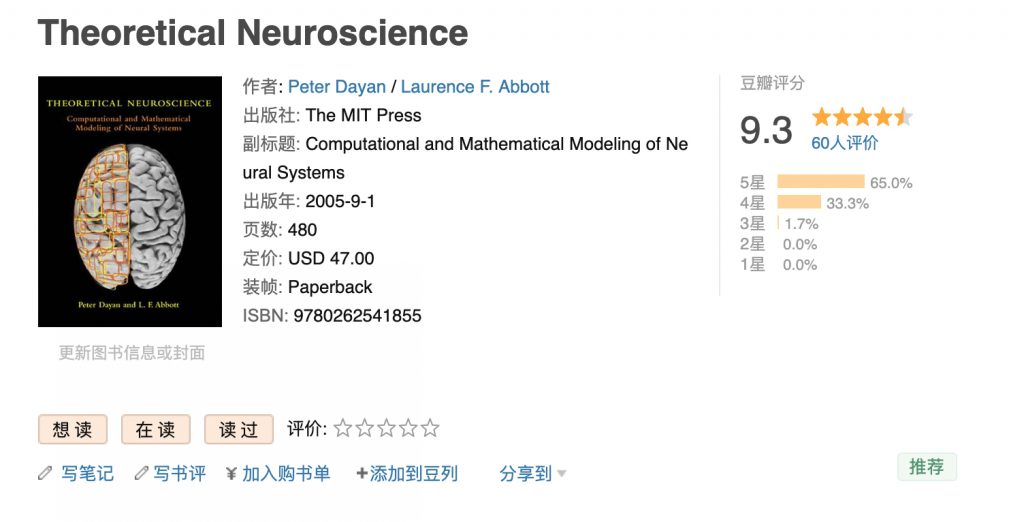

描述性模型整理某一类神经元或者神经结构的大量实验数据, 总结这些数据, 并提出一个计算模型, 这个模型能够良好的适配数据, 说明该神经元或者神经结构都做了什么. 举例来说, 假说我们现在要提出一个神经元的描述性模型, 我们拿到不同实验中, 神经元的输入动作电位和输出动作电位, 然后我们提出了McCulloch-Pitts模型, 完美解释了之前的实验数据, 那么这就是一个很好的描述性模型, 描述性模型更像是一个黑盒模型, 在这里, 我们关心的是神经元到底做了什么—轴突加权和, 非线性转换并转出—而不关心它是怎么做到的.

机制性模型(mechanistic models)

机制性模型则更进一步, 需要理解神经元是怎么做到, 以上面例子来讲, 在神经元的生物形态中, 怎样通过轴突, 树突, 细胞膜和这离子通道来实现一个 *非线性加权和* 的电位过程, 这就需要把解剖学事实、生物物理性质、以及之前的输入输出数据结合在一起, 给出一个符合观测的过程说明. 机制性模型通常会把不同层次的描述性模型联系起来. 还以神经元为例, 在神经元的层面, 一个描述性模型是McCulloch-Pitts模型, 而在离子通道层面, 我们又有一个描述离子通道的翘翘板数学模型(临时起个名字), 那么一个好的机制性模型就会联系这两者, 结合解剖学结构, 说明一个翘翘板样电位值变化如何嵌入非线性加权和的模型中. 从而解释神经元做了什么, 是怎么做到的.

解释性模型(interpretive models)

解释性模型更为宏观, 一般会从可计算理论以及信息论的角度出发, 来理解为什么神经元要这么做, 一个非线性加权和的操作对于这个神经元参加的认知功能是必要的么, 为什么神经元会形成这样的机制, 以这样的执行方式来处理这个问题. 这就是一个典型的解释性模型所要回答的问题.

书的章节安排

本书分三大部分, 一是神经编码和解码, 二是神经元和神经回路, 三是适应和学习.

神经编码和解码主要讨论, 神经系统是通过何种方式把不同的外部信息存储在大脑中的, 这种信息编码方式是什么, 以及在需要对外界反馈的时候, 又是如何将内部编码进行解码, 最终无碍且智能在这个大千世界中行走的. 也就是说, 神经元是如何存储图像, 声音, 文字, 运动反馈等等不同信号的, 又是如何将这种存储提取出来转换为外部信息对外界进行反应的.

神经元和神经回路讨论神经元和实现机制, 电传导机制, 并进一步在神经元的基础上, 讨论神经元聚合之后的神经回路(神经网络)的种类和功能, 在这一部分, 有大家喜闻乐见的前向神经网络, 递归神经网络, 兴奋抑制网络和随机神经网络等内容.

最后一部分将探讨神经可塑性, 经典条件反射与操作性条件学习, 以及当下大热的Representation Learning.

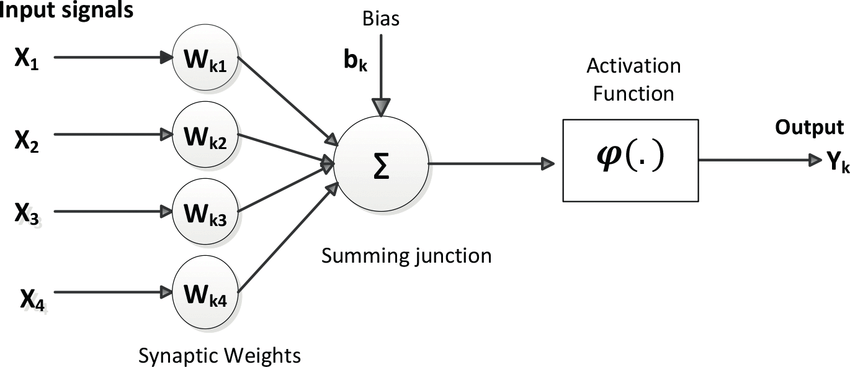

神经元的生物结构与神经脉冲

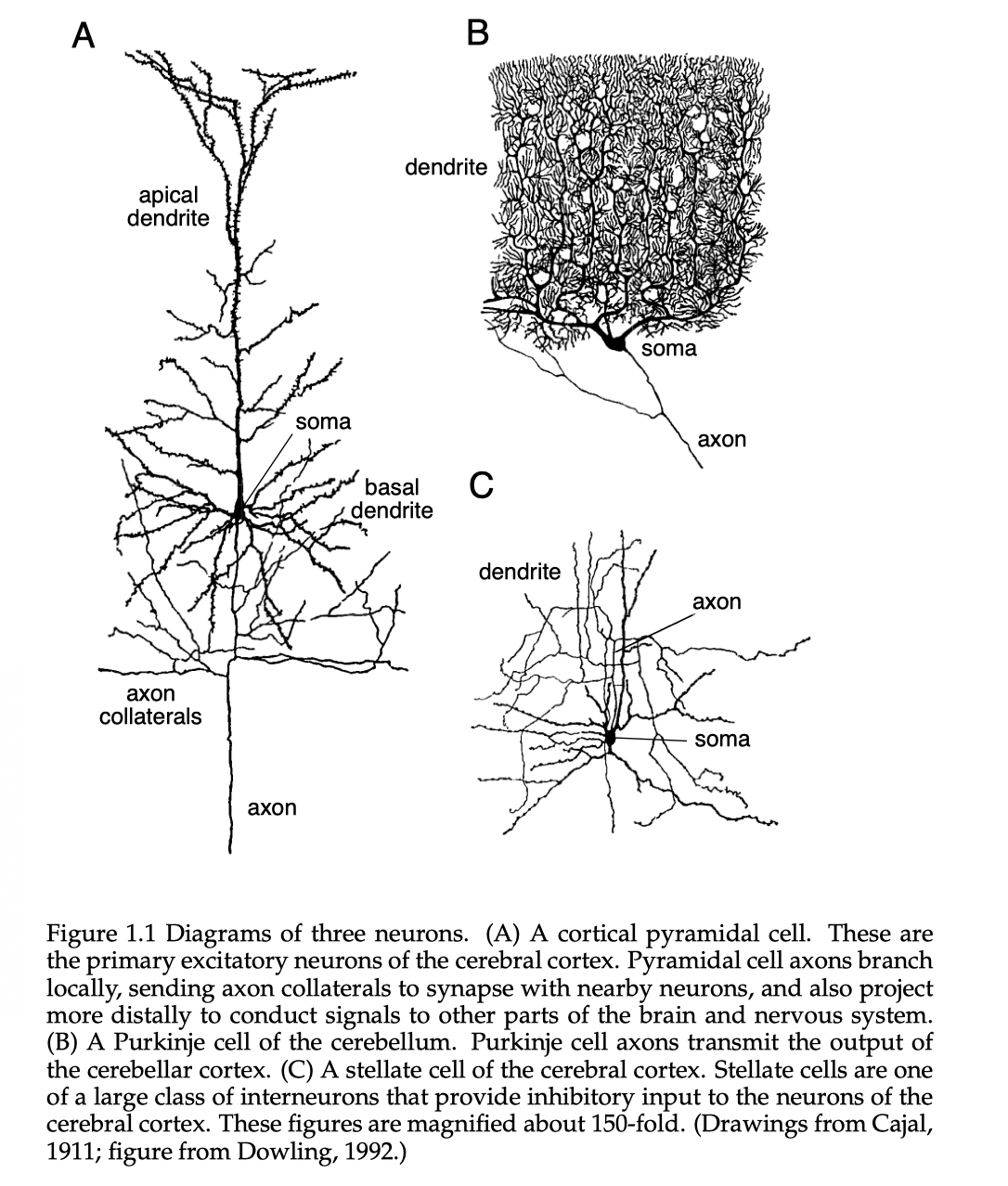

神经元的基本结构已经是众人皆知的模型了, 地球人都知道它由轴突(axon), 树突(dendrites), 细胞核(the soma of cell)三大部分组成, 其中轴突输出, 树突输入, 细胞核处理输入. 整个输入输出以动作电位(action potential)的形式传输. 其概念图如下图所示.

那么我们列举一些不那么广为人知的事情:

1. 不同神经元接受的连接数不同, 典型的如皮层金字塔形神经元(cortical pyramidal neuron), 皮层中间神经元(cortical pyramidal neuron)接受千数量级的连接, 而特别的如小脑浦肯野神经元(Purkinje cell)可以接受多达10万个连接.

2. 轴突的传输距离极长, 甚至可以横跨整个身体. 在小鼠的大脑中, 典型的一个轴突长达4厘米, 每毫米平均有180个与其他树突的连接, 而一个树突, 平均每微米就都有两个神经连接. 与之对比的是, 神经元的细胞核直径大约也只有10微米到50微米, 一微米为百万分之一米.

3. 通常将神经元所处的脑容液的神经电位视为0mv, 这样的神经元内部相对与脑容液为-70mv, 此时这个神经元称为极化细胞, 同时此时的电位差称为静息电位.

4. 默认情况下, 带一个正电子的钠离子在细胞外浓度较高, 而同样带一个正电子的钾离子,在细胞内浓度较高. 当离子浓度差或者电位差导致离子泵打开时, 离子可以在细胞内外进行流动. 如果流动导致膜内外电位差增大, 则称为超极化, 而若使其减小, 甚至使其归零, 则称为去极化.

5. 如果去极化的幅度超过阈值, 那么细胞将产生动作电位, 一个典型的动作电位的电位差大约在100mv, 并能够持续约1ms.

6. 在一个动作电位发动后的几毫秒, 基本上神经元不可能再发动另一次神经脉冲, 这个时间区间称为绝对不应期(absolute refractory period)(好想翻译成绝对静默期啊), 而一个动作电位发动后的数十毫秒, 一般很难再发动一次神经脉冲, 这则称为相对不应期(relative refractory period).

7. 一旦称为动作电位, 即指这些能够进行长距离信息传输的惟一脉冲, 而那些电位差阈值不过限的subthreshold potential, 一般只能传输1毫米那么长…

8. 动作电位传输到轴突末端时, 二价钙离子流出, 并导致神经递质释放, 从而引起下一个神经元的超极化或者去极化反应.

嗯, 今天就总结到这儿. 下周见.